Google comenzó a desplegar nuevas funciones de Inteligencia Artificial (IA) para Gemini Live, su asistente de voz basado en IA, permitiendo ahora el análisis de vídeo en directo a través de la cámara del smartphone y la compartición de pantalla para ofrecer respuestas en tiempo real.

Estas nuevas capacidades fueron anunciadas durante el Mobile World Congress (MWC) a principios de marzo en Barcelona, donde la compañía adelantó que estarían disponibles para suscriptores de Gemini Advanced, dentro del plan Google One AI Premium.

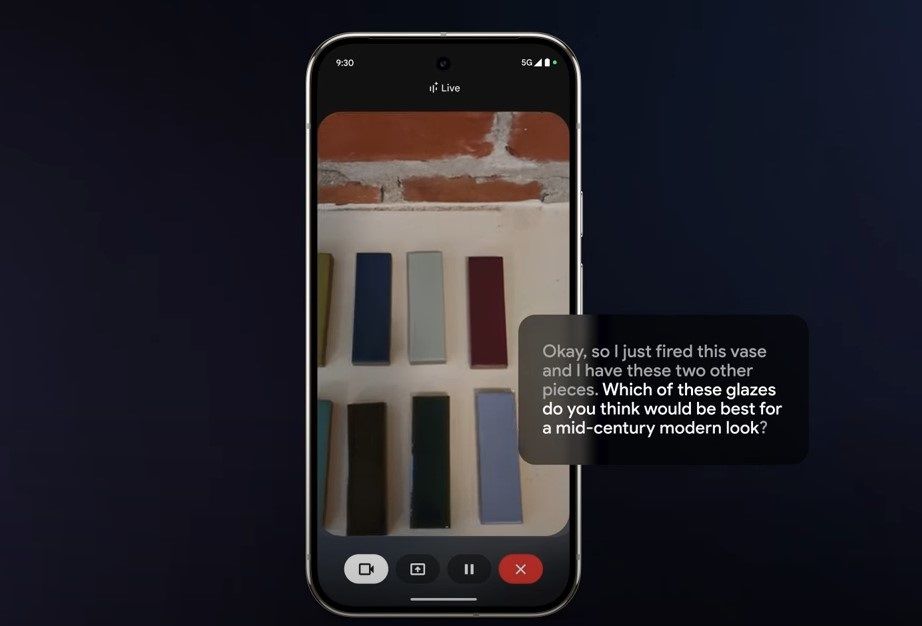

Ahora, Google lo implementa en dispositivos Android, permitiendo a los usuarios utilizar la cámara de su móvil para mostrar imágenes en tiempo real al asistente y recibir información detallada sobre lo que aparece en pantalla.

Además, con la opción de compartir pantalla, Gemini Live puede analizar y comprender los elementos visibles en el dispositivo, ofreciendo respuestas más precisas sobre objetos como prendas de ropa o artículos de decoración.

El portavoz de Google, Alex Joseph, confirmó la llegada de estas funciones a The Verge, tras ser detectadas por algunos usuarios y compartidas en Reddit.

Parte del proyecto Astra de Google

Estas nuevas características forman parte del proyecto Astra, presentado en el evento Google I/O 2024. Este proyecto busca mejorar la capacidad del asistente para responder preguntas considerando el entorno y las acciones del usuario en tiempo real.

Con información de Europa Press

Acerca de los comentarios

Hemos reformulado nuestra manera de mostrar comentarios, agregando tecnología de forma de que cada lector pueda decidir qué comentarios se le mostrarán en base a la valoración que tengan estos por parte de la comunidad. AMPLIAREsto es para poder mejorar el intercambio entre los usuarios y que sea un lugar que respete las normas de convivencia.

A su vez, habilitamos la casilla [email protected], para que los lectores puedan reportar comentarios que consideren fuera de lugar y que rompan las normas de convivencia.

Si querés leerlo hacé clic aquí[+]